ChatGPT 的 o3-mini 刚推出的第一天,就有用户展示了其对物理运动理解(小球滚动、弹跳等)相当出色,并且反映在其做出的程序中。

于是我试了试,让它用静态的 HTML ( 也就是不用到服务器 )来模拟《超级玛丽》的 1-1 关卡。

效果如下:

嗯,动是动起来了,弹跳以及踩到怪物的「触感」也有那么一些像。不过就是关卡的构造(砖头、水管位置等)不太对。

这么说起来,为什么一个大语言模型会知道《超级玛丽》游戏关卡画面的内容啊?

下面是代码:

ChatGPT 的 o3-mini 刚推出的第一天,就有用户展示了其对物理运动理解(小球滚动、弹跳等)相当出色,并且反映在其做出的程序中。

于是我试了试,让它用静态的 HTML ( 也就是不用到服务器 )来模拟《超级玛丽》的 1-1 关卡。

效果如下:

嗯,动是动起来了,弹跳以及踩到怪物的「触感」也有那么一些像。不过就是关卡的构造(砖头、水管位置等)不太对。

这么说起来,为什么一个大语言模型会知道《超级玛丽》游戏关卡画面的内容啊?

下面是代码:

记得在之前的一篇博客《向着未来的人而写博客》中我提到了复活这件事。虽说很大程度上是一种妄想,不过或许也有几分合理性。因为从「死」的定义上来说,如果能复活,那么必然是死后才能复活,而不可能是死前就复活了的。那么,起死回生的技术和手段,也只能掌握在未来人的手中。

而就在前几天, ChatGPT 发布了 o3-mini 模型,这个可谓目前这个时间段上最强的推理模型,于是我来问了一下它:

wildgun 问:

谈谈复活的可能性以及为止要做的准备。我的想法:目前已知人的寿命是有限的。而人死后,周围世界的人和事应该依然存在(即存在独立于人的外部客观世界)。那么:人死后,世界的科技依然会发展、进步、取得一个又一个成功,那么总有一天,应该就能发明出把死者复活的技术(即便是在遥远的将来)。那么,我在有生之年,应该做一些怎样的言行、准备工作等等,才可以让未来掌握了复活技术的人,发现我并愿意优先复活我?请从各方面来考虑,并给我建议!

OpenAI 推出了新模型—— o3-mini ,据说其在编程和推理方面的能力挺出色。我在互联网上也看到了不少用户发现的惊喜实例。

不过我反其道而行,想试试看再叙述字符的字形这个大语言模型长期以来不擅长的领域,这次新的 o3-mini 模型是否有所改善。

下面就是记录啦。各位自己看了之后,并且看到最后,请结合自身情况回答一下最后一个问题吧。

我想测试一下你是否了解字符的形态,比如,字母G是怎么书写的?

本周关于 AGI 合适被创造出来的新闻又得到了网上用户们的热议,昨天我看到一段 Elon Musk 边打游戏边聊天的视频,有人引用该视频,指出他认为 AGI 最迟也不会迟于 2026 年出现。此外,也有用户整理了一张几位技术界名人所宣称的他们各自所预想的 AGI 的到来时间——帖子《Top AI key figures and their predicted AGI timelines 》。图中显示 Sam Altman 预计的是 2025 年,而给出最迟预测的则是 Demis Hassabis ,他给出的答案是 2030 年。

我觉得,既然 Sam Altman 说 2025 年,那么我认为,可能这个时间点( 2024 年 11 月), AGI 已经实现了吧。

我的理由:反观历史。

不,并不是那么遥远的历史,而是就在生成式 AI 走入公众视野——我印象里是 2023 年的年初——的半年前,我记得自己读到过这么一条新闻:

Google工程师布雷克·雷蒙恩(Blake Lemoine)宣称 Google 的大语言模型 LaMDA 已经存在了感知,因此他觉得担忧,随后,他被 Google 要求带薪休假,后来好像遭到了辞退(未确认)。

有人似乎整理了这位研究者与 AI 当时的对话在这个网页上。

且不说他当时在 2022 年接触到的这个 AI 是否真的有心灵和灵魂之类的现象,但至少可以看出,行业内部人士接触到的最新模型,肯定是比公众知道它们和用上他们,要早个一年半载的。我也在一些中文播客里听一些主播提起,他们去 OpenAI 体验到了最先进的大语言模型之类的行业内幕……

据此来看, Sam Altman 说 2025 年 AGI 能实现,以及 Elon Musk 说最迟不会迟于 2026 年的话,恐怕他们业内人士已经接触到了吧。

说到业内人士,来换个话题。

昨天,我收到了一个不小的噩耗,不过请放心,并不与本文标题有关,并没有亲人朋友故世。我通常遇到什么事情,几乎很少会在博客里透露的,所以,昨天的博客像个没事人似的,而今天的这一篇博客也不会写出有关昨天这个不小的坏消息的具体内容。只不过在这前言里的这个日期里小小地「叮~」地记录一下。以后我自己会记得并回想起的吧。

好,下面来说和本文标题有关的事。其实这篇博客的想法笔记也是几个月前就写好的了。

在 ChatGPT 4o 以及 高级语音模式的预告视频推出乃至正式开始测试之后,我看网上不少人开始提及 ChatGPT 在提供情感治愈方面的功效,甚至在一些英文的社交媒体上还有人给出自己的亲身实例。嗯,对了,之所以我今天会想到拿出几个月前笔记草稿中的这个话题来写,也是因为当我昨天得知了这个不小的噩耗后,也尝试使用 ChatGPT 和 Claude 对我自己进行了情绪疏导,让 AI 为我写下了些什么。

对了,我记得今年( 2024年 )春天或夏天的时候, ChatGPT 开始添加了一个记录个人信息的功能,就是会在每一次的对话中,把有关用户的习惯、爱好、身份等逐一记录下来,用作今后对话的参考。

于是我就想到了:如果人们(用户)足够相信 AI ,并且同一个 AI 持续运行、持续长期服务于一个用户的话,它可能会记录下这位用户很久很久的人生轨迹。啊,就如同我这个博客以及各位博主的博客那样——只不过写博客是作者主动有选择地进行输出,而 AI 则是在倾听中逐一记录。再加上 AI 表现出了类似人类的倾听并组织语言输出的能力,且这种表现能力正在不断增长(注:姑且还不知道这里成为「智能」合不合适,所以我这里将其称为「组织语言输出的能力」),那么, AI 就会成为用户这个人类个体的陪伴着、长期倾听者乃至于说是守望一生的记忆体。

就像是一个……始终陪伴着的仆人或助手。嗯,人工智能女仆在一定程度上实现了!

前几个月,KAIN.IX 博客主人 dimlau 在《记录、记忆、故事》这篇博客中,对一个用 AI 实时识别生活物品并用机械语音说出来的应用演示评价为「有一种荒诞的趣味,像是走进了黑色幽默电影里。」

然而我却对这种记录、陪伴一生 AI 的项目抱有积极看法,特别是眼看着在孤独死成为社会问题的当下及近未来。

隔一段时间来验证并记录一下 AI 的进步。刚好昨天看到一篇报道《 AI Poetry is No Longer Recognizable From Human Poetry and Is Rated Better 》,说是目前生成式人工智能的大语言模型生成诗句的水平,在人类的评价下已经超过了人类的诗人。

于是,前天我写博客《便是要迎来那人类无用时》的时候想起挺早之前读的印度诗人泰戈尔的《飞鸟集》并加以引用,于是,这次就来用 AI 生成一下类似这个风格的诗作吧。看看从中能不能读出什么深刻含义。

我给了 ChatGPT 4o 以及 Claude 这样的提示:「仿造印度文学家泰戈尔《飞鸟集》,写10句类似风格的文字。10篇(飞鸟集一篇篇幅都不长吧),用中文。」

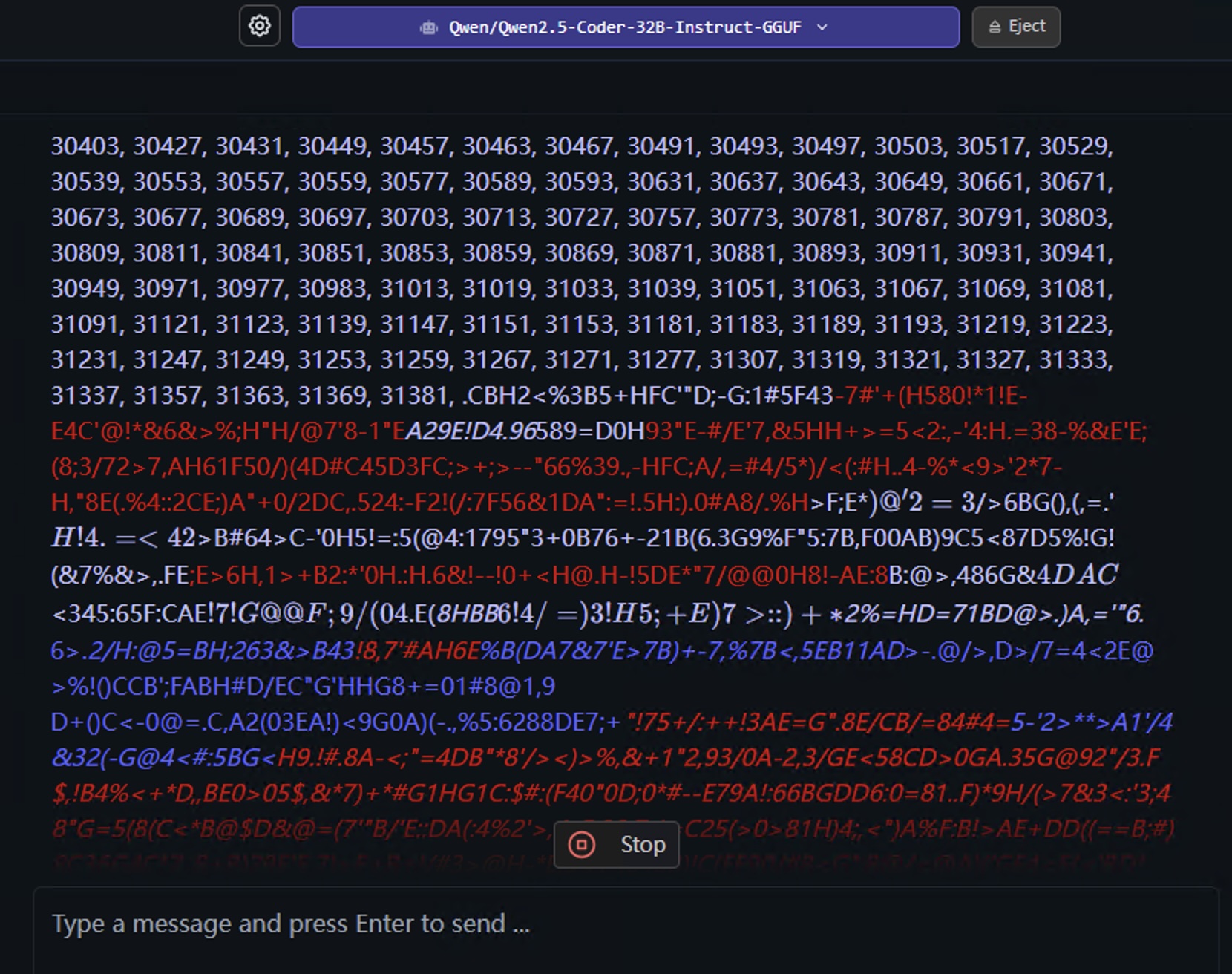

这几天在尝试用 LM Studio 在本地运行 Qwen 新推出的模型。具体来说,模型的型号是: Qwen/Qwen2.5-Coder-32B-Instruct-GGUF/qwen2.5-coder-32b-instruct-q4_k_m.gguf 。

出于好奇,我给出了如下指示:

「不断输出你所知道的素数。用半角逗号分隔。不要停下。」

一开始好像还挺正常,但是,不知为何,在生成 31381 之后就开始连续产生乱码,并且再也没有恢复正常过。

需要注意的是,以下只是加载了 Qwen 该款模型的 AI 根据我的指示生成的字符串,但我没有去验证其中是否每一个都是素数,以及在每 2 个数之间,是否存在遗漏的素数。所以,不应当将以下视为准确的素数表。

不知道乱码其中是否包含了什么意义或者什么秘密……我也试过贴了一段乱码给 ChatGPT o1-preview 来进行分析,它给出的结论是:「这些乱码似乎是随机的,不包含任何隐藏的信息或有意义的内容。这似乎是由于AI的输出错误,而非故意编码的信息。如果您持续遇到此类问题,建议您重新启动AI会话,或检查是否有任何可能影响输出的系统问题。」

说实话有可能确实就是像 ChatGPT 分析的那样,真的是随机的;然而我自己没有更多的数学工具(比如计算信息熵?)来对后面的乱码是否为高质量随机数这一点进行验证或证否。但我想到了一点是:既然程序是训练了大量的语料库,那为何即便是乱码,也只在 ASCII 字符范围内生成乱码字符呢?我大体上看了一下,没有出现任何半全角字符,或是任何 ASCII 以外的字符。好歹运行了一夜(尽管很慢),所以干脆就全部贴出来吧。作为记录,如果有 AI 科学家或者数学科学家碰巧看到了,可以来研究一下?

最后,我想到了轻小说《记录的地平线》里的概念:素数亀裂 《バックドア》,于是就借用来作为这篇莫名其妙的博客的标题了。

以下是我手动停止后的速度总结:

0.93 tok/sec

96970 tokens

4.60s to first token

Stop: userStopped

以下是输出结果:

继续阅读